検証可能なプライバシーと透明性:Brave AIプライバシーの新境地

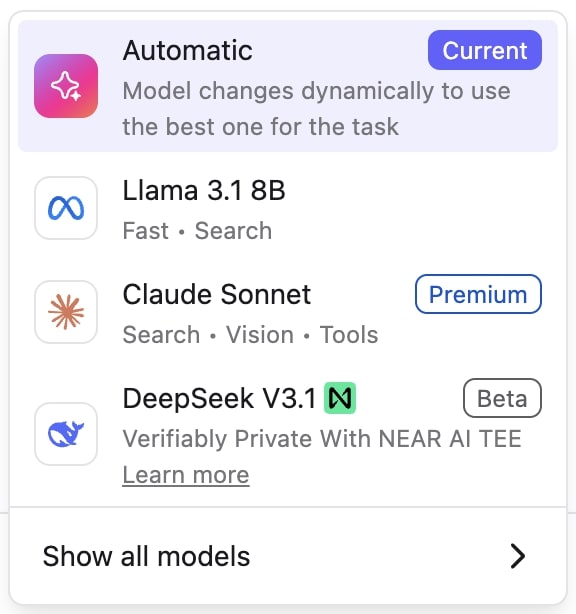

本日Brave Leoは、NvidiaがサポートするNEAR AIのTrusted Execution Environments(TEE、詳細は下記の「TEEについて詳しく知る」セクションを参照)を用いてLLMを展開することで、新たな形で 暗号学的に検証可能なプライバシーと透明性 を提供します。Braveは、ユーザーがAIモデルとプライベートな会話をしていることを検証できなければならないと考えています。この機能は、DeepSeek V3.1を用いた初期実験として、Brave Nightly(当社のテストおよび開発チャンネル)で利用可能です(フィードバックに基づいて、将来的にはより多くのモデルに拡張する予定です)。

Trusted Execution Environmentsを統合することで、Brave LeoはAIアシスタントにおいて比類のない検証可能なプライバシーと透明性の提供に向けて前進し、ただ単に「俺を信じろ」というだけのプロセスから、Braveが目指す「信頼するが検証もする」というプライバシー・バイ・デザインのアプローチへと移行します。

AIはユーザーファーストであるべきとBraveは信じています

Leoは、Braveブラウザに統合されたプライバシーを保護したAIアシスタントです。最先端のLLMを搭載しながら、プライバシーを保護したサブスクリプションモデル、クラウドでのチャットやコンテキスト保存をしない、IPアドレスのログも残さない、ユーザーの会話を学習に使用しない、という特徴によりユーザーのプライバシーを保護しています。

Braveは以下について、可能であるべきと考えます。

-

プライバシーの検証可能性—ユーザーはLeoのプライバシー保証が、公表されているプライバシーの約束と一致していることが検証できなければなりません。

-

モデル選択における透明性の検証可能性—ユーザーは、Leoの応答が実際にユーザーが選択している機械学習モデルから来ていることを検証できなければなりません(Leo Premiumの場合は料金を支払っているためなおさらです)。

他の競合チャットボットプロバイダーにこれらのユーザーファーストの機能が欠けていることは、プライバシー保護を装う(実際には保護していない)見せかけだけのプライバシー保護というリスクをもたらします。また、研究("Are You Getting What You Pay For? Auditing Model Substitution in LLM APIs")と実際の事例(例:ChatGPTに対する反発)の両方において、チャットボットプロバイダーがGPUコストを削減し利益率を高めるために、高価なLLMを密かに実行コストの安い弱いLLMに置き換え、その弱いモデルからの結果をユーザーに返す動機を持つ可能性があることが示されています。

BraveはConfidential Computing(機密コンピューティング)を通じて、LLMにおける検証可能なプライバシーと透明性に向けて前進しています

この取り組みを開始するにあたり、Braveは、NEAR AI TEEのConfidential LLM Computing(機密LLMコンピューティング)を使用し、LLM/APIプロバイダーへの信頼を不要とします。BraveはNEAR AI TEE対応のNvidia GPUを使用し、データとコードが暗号化されて処理される安全な隔離領域を作成することで、機密性と完全性を確保します。

この隔離領域(TEE)は、読み込まれたモデルと実行コードの測定値(ハッシュ)を含む暗号学的な証明レポートを生成します。この証明レポートを暗号学的に検証することで、以下のことについて確実な保証が得られます。

-

正規のNvidia GPU TEEによって安全な環境が作成され、その完全性と設定の暗号学的な証明が生成されます。

-

推論はこの安全な環境内で完全な暗号化のもとに実行され、ユーザーデータのプライバシーが保たれます。つまり、ユーザーが計算に渡したデータも、計算結果も、誰も見ることができません。

-

すべての計算に暗号学的な署名を行うことで、ユーザーが意図したモデルとオープンソースコードが改変されずに実行されます。

開発の第一段階では、Braveが暗号学的な検証を実行し、ユーザーは以下の手順でLeoの NEAR AI TEEによる検証可能なプライバシー を確認できます。

-

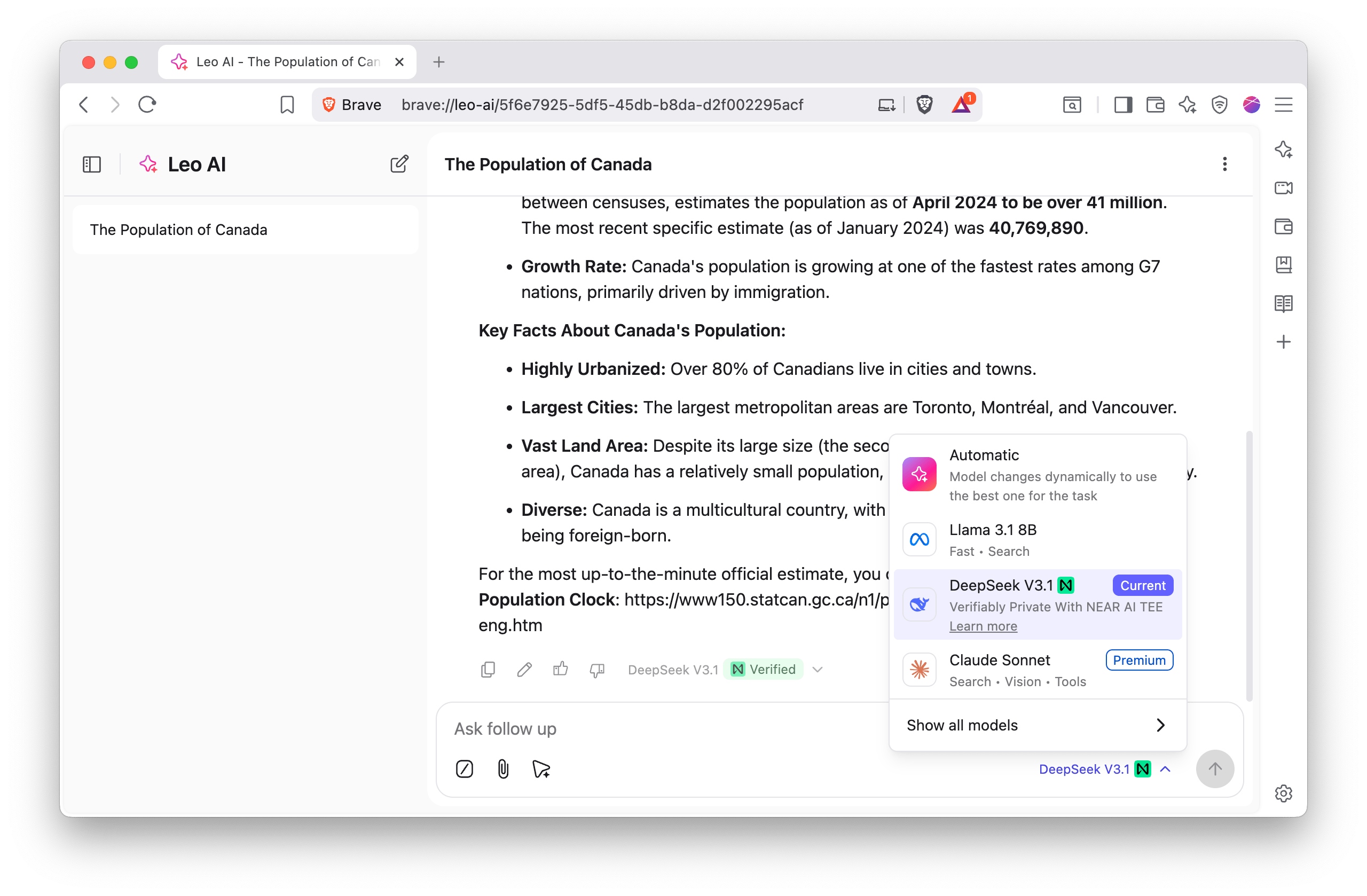

Brave NightlyのLeoで利用可能な「Verifiably Private with NEAR AI TEE(NEAR AI TEEによる検証可能なプライバシー)」というラベルが付いたDeepSeek V3.1を選択します

-

BraveがNEAR AI TEE検証を実行し、NEARオープンソースコードからハードウェア証明実行までの暗号学的なチェーンを検証することで、応答が特定バージョンのNEARオープンソースサーバーを実行している正規のNvidia TEE内で生成されていることを確認します。

-

Braveは検証結果を、検証済みを示す緑色のラベルでユーザーに伝えます(以下のスクリーンショットを参照)。

-

ユーザーはプロバイダーの善意に頼らず、技術的に保証されたプライバシーのもとでチャットを開始できます。

Brave Leoの検証可能なプライバシー/透明性のこれから

本日、私たちはTEEベースの機密性を保証するDeepSeek V3.1コンピューティングをBrave Nightly(テストおよび開発チャンネル)でリリースしました。これはフィードバックを目的とした先行的、実験的なリリースです。

より広範囲に展開する前に、私たちは2つのことに注力しています。

-

ユーザーが体感するパフォーマンス低下がないこと — TEEはGPU上でいくらかの計算オーバーヘッドを発生させます。しかし、最近の進歩により、このオーバーヘッドは大幅に削減され、Confidential Computing on NVIDIA Hopper GPUs: A Performance Benchmark Study(論文) で示されているように、場合によってはほぼゼロになります。私たちは、ユーザーにパフォーマンスの低下を感じさせないようにしたいと考えています。

-

エンドツーエンドの検証 — 私たちはLeoにおける機密コンピューティングを拡張し、ユーザーがパイプライン全体への信頼を検証できるようにする研究を進めています。Braveがすべての段階をオープンソース化することも検討しています。特に、ユーザーがBraveブラウザ内で自分自身でAPI検証を再確認できるように、ユーザーが直接検証できるようにする計画をしています。

Trusted Execution Environmentsについての更なる詳細

Trusted Execution Environment(TEE)は、プロセッサ内の安全な領域であり、オペレーティングシステム(OS)などの従来のリッチランタイム環境から分離された、独立したコンピューティング環境を提供します。TEEは、ホストするコードとデータに対して、機密性と完全性の強力なハードウェアベースの保証を実施します。これらの保証は、TEEのみがアクセスできる専用メモリなどの強制措置によって実現されます。

ハードウェア分離により、OSが完全に侵食された場合でもTEE内に存在するコードやデータにアクセスしたり改ざんしたりすることはできません。さらに、TEEはセキュアブートやリモート認証などの独自のハードウェアプリミティブを公開し、信頼できるコードのみがTEEにロードされることを保証し、外部の関係者がTEEの完全性を検証できるようにします。

チップメーカーは、従来型のCPUと最近浸透しつつあるGPUの両方でTEEを有効にしています。TEE対応CPU(例:Intel TDX)とTEE対応GPU(例:Nvidia Hopper)の組み合わせにより、最小限のパフォーマンスペナルティでLLM推論のエンドツーエンドの機密性と完全性を保持する計算が可能になります。