Brave führt bisher leistungsstärkste Such-API für KI ein

Tests belegen, dass die hochwertigen Grounding-Daten von Brave es günstigeren Open-Weight-LLMs ermöglichen, sich gegen ChatGPT, Google AI Mode und Perplexity durchzusetzen

Heute führen wir eine überarbeitete Version der Brave Search API ein, die die Websuche für KI-Anwendungen erheblich nützlicher macht. Das neue Release umfasst drei wichtige Neuerungen: die bisher leistungsstärkste Such-API, erweiterte Entwicklertools und einfachere, günstigere Tarife mit größerem Leistungsumfang. Zusammen mit dem Release stellt Brave Forschungsergebnisse vor, die belegen, dass sich weniger leistungsstarke Open-Weight-LLMs gegen führende LLMs durchsetzen können, wenn sie die qualitativ hochwertigeren API-Daten von Brave verwenden, die mit diesem Release verfügbar sind. Zu den Neuerungen gehören:

-

Die LLM Context API: Dies ist die bisher leistungsstärkste Such-API für KI-Anwendungen, die dafür optimiert ist, für Large Language Models (LLMs) hochrelevanten Kontext aus dem Web für jegliche Anfragen oder Fragen bereitzustellen. Die LLM Context API wird bereits intern in großem Umfang eingesetzt und ermöglicht über 22 Millionen Antworten pro Tag in Brave Search, der größten privaten, benutzerorientierten KI-Anwendung der Welt. Eine Version von Ask Brave, dem Chatbot von Brave, der auf LLM Context von Brave und dem Open-Weight-Modell Qwen3 basiert, übertrifft ChatGPT, Perplexity und Google AI Mode im direkten Vergleichen aufgrund hochwertiger Kontextdaten (siehe nachstehende Tabelle).

-

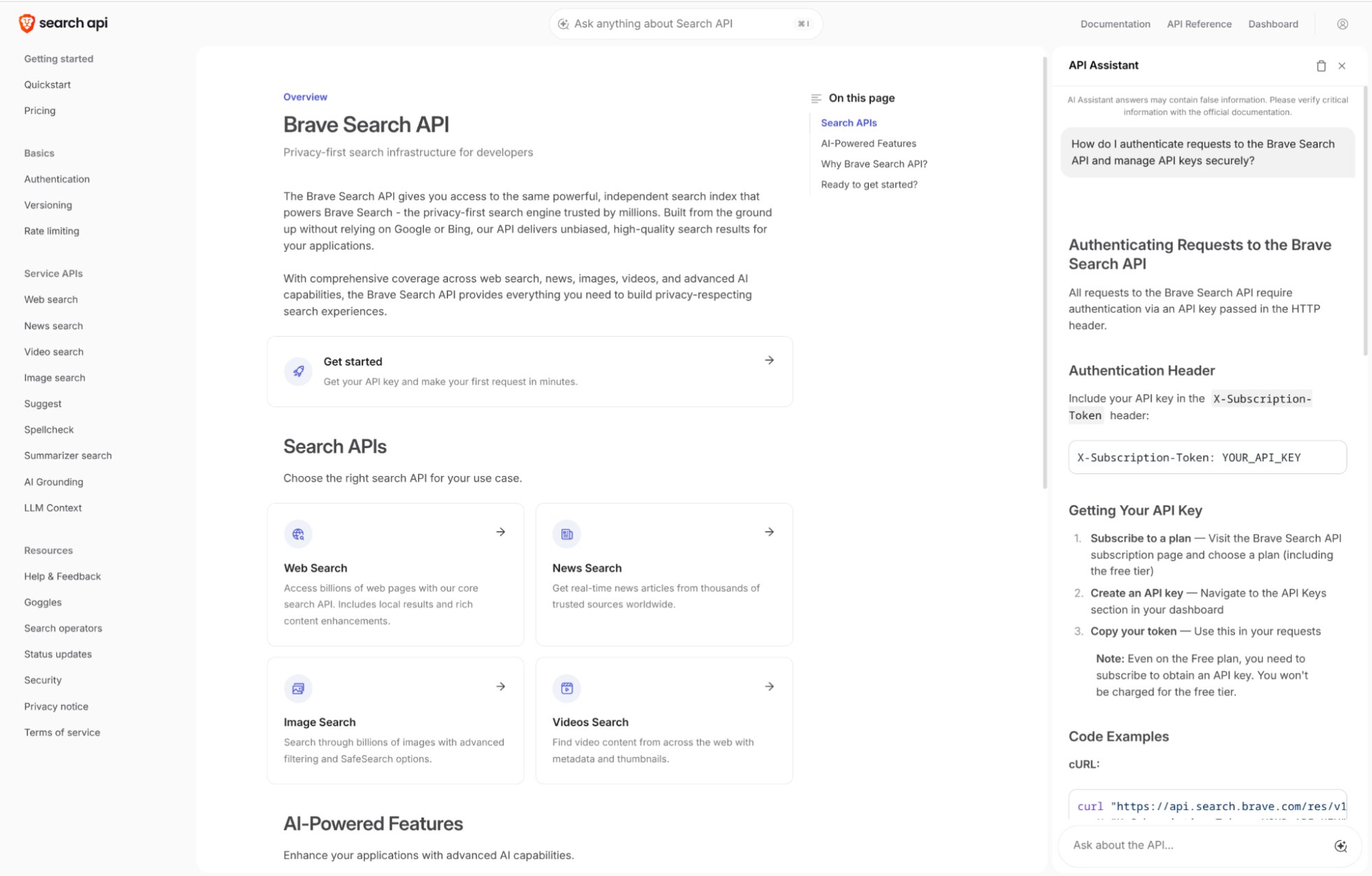

Entwicklertools: Wir veröffentlichen Brave Search API Skills und einen in das Entwicklerportal integrierten API-Assistenten, der Sie bei der Beantwortung jeglicher Fragen zur optimalen Nutzung der Brave Search API unterstützt. Auf diese Skills können Sie auch mit den meisten KI-Tools für Entwickler wie Cursor, OpenCode oder Claude Code zugreifen.

-

Einfachere, günstigere Tarife mit größerem Leistungsumfang.* Die beiden neuen Tarife – „Search“ und „Answers“ – beinhalten alles, was Sie brauchen. „Search“ umfasst sämtliche Suchkategorien: Web-, LLM Context- (heute neu veröffentlicht), Bilder-, Nachrichten- und Videosuche sowie weitere Optionen – alles zu einem Preis von 5 $ pro 1.000 Anfragen. Der Tarif „Answers“ bietet fundierte Antworten auf Ihre Fragen, zusammen mit den Webergebnissen, auf denen diese Antworten basieren. Der Preis für den Tarif „Answers“ beträgt 4 $ pro 1.000 Websuchen zzgl. 5 $ pro Millionen Token (Input und Output).

Die Websuche gehört zur grundlegenden Infrastruktur für Web und KI. Brave Search ist einer von nur drei unabhängigen, global ausgerichteten Suchindizes in der westlichen Welt – und der einzige, der kein Big-Tech-Angebot ist. Zudem handelt es sich um den einzigen Index, der über offene, moderne und für LLMs entwickelte APIs verfügbar ist und eine öffentliche API mit Optionen für SOC2-Konformität und Zero Data Retention bietet.

Die LLM Context API

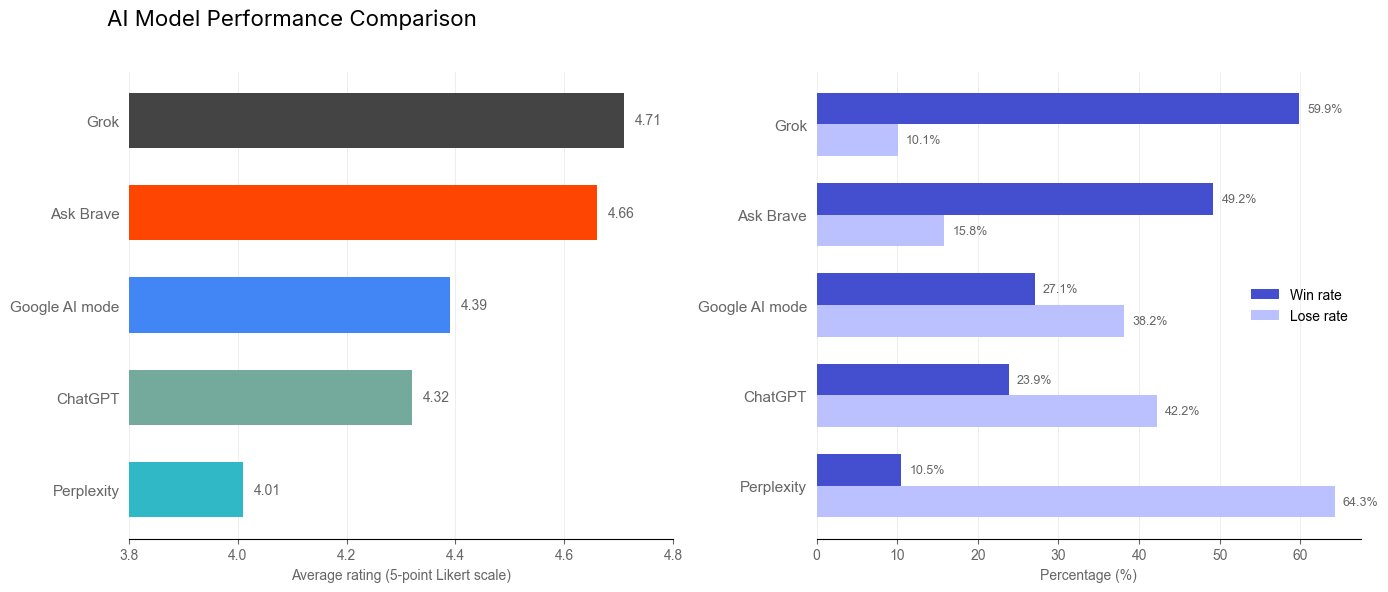

Im Rahmen einer internen Evaluierung führender KI-Suchmaschinen lässt Ask Brave, das auf der LLM Context API von Brave und dem Open-Weight-Modell Qwen3 basiert, ChatGPT, Perplexity und Google AI Mode hinter sich. Bislang lag das Hauptaugenmerk der KI-Branche auf den Vorteilen und dem Wert von High-End-Modellen. Unsere Tests zeigen jedoch, dass weniger leistungsstarke Open-Weight-Modelle bei Einbindung hochwertiger Grounding-Daten Closed-Frontier-Modelle übertreffen können. Dabei handelt es sich um die Daten, die die von uns heute veröffentlichte LLM Context API bereitstellt. Damit können alle, die mit KI entwickeln, ähnliche hochwertige Ergebnisse erzielen.

Die LLM Context API ist ein einzigartiges Angebot, das ein datenzentriertes Ranking bietet, bei dem die relevantesten intelligenten Datenpakete in einem kompakten, für den LLM-Konsum optimierten Format geordnet und zusammengestellt werden. Dadurch wird die Genauigkeit des extrahierten Grounding-Kontexts optimiert. Ermöglicht wird dies durch die umfassende Suchmaschineninfrastruktur von Brave (im Gegensatz zu Scrapern, die mit Latenzproblemen zu kämpfen haben und deren Datenzugriff eingeschränkt sein kann).

Bewertung

Am 30. November 2025 haben wir eine ausführliche Evaluierung führender KI-gestützter Antwort-Engines durchgeführt und dabei Claude Opus 4.5 und Claude Sonnet 4.5 zur Bewertung herangezogen.

Dazu wurden Antworten von Ask Brave, Grok, Google AI Mode, ChatGPT und Perplexity gesammelt, wobei derselbe Satz von 1.500 Suchanfragen verwendet wurde, die nach dem Zufallsprinzip aus tatsächlichen Suchanfragen ausgewählt wurden (z. B. „sammelt das iPhone Daten, wenn es ausgeschaltet ist“). Abgesehen von den Antworten von Ask Brave wurden alle Antworten mit Bright Data extrahiert. Ziel der Nutzung eines Scraping-Dienstes ist es, für jeden Anbieter genau das Erlebnis zu erfassen, das ein anonymer Benutzer machen würde.

Die Antworten wurden dann mithilfe von LLM-as-Judges bewertet (sowohl Claude Opus 4.5 als auch Claude Sonnet 4.5 wurden im Rahmen einer Mehrheitsabstimmung eingesetzt). Dabei wurden alle paarweisen Vergleiche berücksichtigt (alle möglichen Paare wurden evaluiert, um ein Höchstmaß an Zuverlässigkeit zu gewährleisten) und es wurde eine Kontrolle der durch die Reihenfolge bedingten Verzerrung durchgeführt, indem jedes Paar zweimal bewertet wurde (A im Vergleich zu B und _B im Vergleich zu A_ׅ).

| Absolute Kategoriebewertung (Likert-Skala mit 5 Punkten) | Durchschnittliche Win-Rate | Durchschnittliche Lose-Rate | |

|---|---|---|---|

| Grok | 4,71 | 59,87 % | 10,05 % |

| Ask Brave | 4,66 | 49,21 % | 15,82 % |

| Google AI Mode | 4,39 | 27,07 % | 38,17 % |

| ChatGPT | 4,32 | 23,87 % | 42,22 % |

| Perplexity | 4,01 | 10,51 % | 64,26 % |

Grok schneidet am besten ab, dicht gefolgt von Ask Brave, obwohl Ask Brave ein leistungsschwächeres Open-Weight-Modell (Qwen3) verwendet. Der wesentliche Unterschied bei diesen Tests bestand darin, dass Ask Brave den höherwertigen Kontextendpunkt für das Grounding verwendet, nämlich die heute veröffentlichte API. Systeme mit eingeschränktem Zugriff auf den Suchindex schneiden deutlich schlechter ab, was zeigt, dass die Kontextqualität wichtiger ist als die Leistungsfähigkeit des Modells.

Daraus lässt sich schließen, dass die Kontextqualität der wahrscheinlich wichtigste Faktor für die Qualität der Antworten ist. Ein Open-Weight-Modell mit modernstem Grounding konkurriert mit hochperformanten Frontier-Modellen, die mit geringerer Kontextleistung arbeiten, und schneidet oft besser ab. Angesichts der zunehmenden Verbreitung großer Modelle sollte die Bedeutung hochwertiger Daten die Einschätzung von Investoren darüber verändern, was den wirtschaftlichen Wert von KI ausmacht.

Hier erfahren Sie mehr über den Evaluierungs-Prompt 1.

So funktioniert LLM Context

Die standardmäßige Websuche ist für Menschen optimiert und konzentriert sich daher auf URLs. Um jedoch KI- und LLM-Anwendungsfälle besser zu unterstützen, wurde die überarbeitete Such-API von Brave für die maschinelle Nutzung optimiert. Die LLM Context API geht noch einen Schritt weiter und bietet ein datenzentriertes Ranking, bei dem die relevantesten intelligenten Datenblöcke in ein kompaktes, für die LLM-Verwendung optimiertes Format kompiliert werden.

Folgendes läuft den einzelnen Anfragen ab:

-

Die standardmäßige Websuche wird mit dem unabhängigen Index von Brave durchgeführt, um die relevantesten und qualitativ hochwertigsten Seiten zu identifizieren.

-

Anschließend durchforsten wir den Inhalt jeder Seite in Echtzeit und wandeln HTML-Rohinhalte in intelligente Datenblöcke um. Wir bieten weit mehr als die übliche Konvertierung von Webseiten in Markdown und haben die Verarbeitung für Folgendes optimiert:

-

Extraktion von bereinigtem Text mithilfe von anfrageoptimierten Snippets, Markdown-Konvertierung und anderen Formen von Extraktion von bereinigtem Text. Dem liegt die jahrelange Erfahrung zugrunde, die wie bei der Entwicklung und Skalierung von Brave Search gewonnen haben.

-

Extraktion von strukturierten Daten (JSON+LD-Schemas, Itemprops, Tabellen mit Granularität auf Zeilenebene usw.)

-

Extraktion von spezialisiertem Code-Kontext, der insbesondere für technische Fragen und Coding Agents eine Rolle spielt.

-

Extraktion von Diskussionen in Foren.

-

Verarbeitung von YouTube-Untertiteln.

-

-

Außerdem ordnen wir diese intelligenten Datenblöcke mithilfe eines internen Systems, das dafür trainiert wurde, die relevantesten Informationen für die Anfrage zu identifizieren. Die endgültige Antwort wird entsprechend der vom Benutzer angegebenen Konfiguration kompiliert, sodass Sie u. a. die Gesamtzahl der Token und die Anzahl der URLs genau steuern können.

Dieses Verfahren führt zu detaillierten und umfangreichen Resultaten und maximiert die Präzision des extrahierten Grounding-Kontextes durch Berücksichtigung der besten Ergebnisse – und das alles ohne Einbußen bei der Latenz.

Diese Schritte wurden stark optimiert, um den zusätzlich zur normalen Suchzeit anfallenden Overhead auf ein Minimum zu begrenzen. In der Praxis beobachten wir einen Overhead beim 90. Perzentil von unter 130 ms, zusätzlich zur normalen Suchzeit, was zu einer Gesamtlatenz von unter 600 ms beim 90. Perzentil für Aufrufe von LLM Context führt.

Einzigartige Kontrollmöglichkeiten

Die LLM Context API arbeitet mit Focus Search, dem Suchtool von Brave, sowie mit dem neuen LLM-Kontext-Budget (welches eine Möglichkeit bietet, ein Token-Budget festzulegen, um die Ausgaben detailliert zu kontrollieren). Darüber hinaus unterstützt sie die lokale Suche. Sehen wir uns dies der Reihe nach an:

Unterstützung für Focus Search

Focus Search ist eine speziell entwickelte Funktion von Brave Search. Sie ermöglicht es Ihnen, Ergebnisse nach Domain- oder URL-Mustern zu filtern, zu verbessern oder herabzustufen, und kann für Tausende von Regeln skaliert werden. Kein anderer Anbieter von Suchmaschinen (und entsprechend auch von LLM-Kontext) bietet dieses Maß an Kontrolle. Hier findest du weitere Informationen zu Focus Search.

LLM-Kontext-Budget

Mit dem optionalen API-Parameter „maximum_number_of_tokens“, der eine Obergrenze für die (geschätzte) Anzahl von Token für die endgültige Antwort angibt, können Sie die Größe des resultierenden LLM-Kontexts genau festlegen. Der Auswahlprozess berücksichtigt diese Begrenzung und priorisiert die relevantesten Daten, um die Budgetvorgaben einzuhalten.

Weitere Optionen ermöglichen es Ihnen, den Beitrag jeder URL, die maximale Anzahl der Ergebnisse oder die Art des Rankings zu optimieren, um die API an Ihren speziellen Anwendungsfall anzupassen.

Lokalisierter Kontext

Bei standortbezogenen Anfragen haben Sie die Möglichkeit, den Standort des Benutzers über Header zu übergeben. Die API gibt dann Folgendes zurück:

-

POI-Daten: Point-of-Interest-Informationen für lokale Unternehmen

-

Kartenergebnisse: Ortsspezifische Ergebnisse mit geografischem Kontext

Wir teilen das Token-Budget effizient zwischen lokalen, Karten- und globalen Web-Ergebnissen auf. In unserer Dokumentation erhalten Sie weitere Informationen zur API**.**

Entwicklertools

Mit diesem Release ist Brave Search noch benutzerfreundlicher geworden. Wir unterstützen Skills und bieten einen integrierten KI-Assistenten, der dafür trainiert wurde, Fragen dazu zu beantworten, wie Sie die Brave Search API am besten für Ihre Anforderungen nutzen können.

Skills

Die Brave Search API unterstützt nun Skills – eine effektive Möglichkeit, KI-Funktionen mit modularen, wiederverwendbaren Workflows zu erweitern. Diese Skills, die nun hier als Open-Source-Tools in einem standardisierten Format vorliegen, ermöglichen es Ihrem KI-Editor oder Ihrer CLI, dynamisch Anweisungen, Skripte und Ressourcen für spezielle Aufgaben zu laden, bei denen die Brave API Unterstützung bieten kann. Diese dienen dazu, den über 200.000 Entwicklern zu helfen, die sich vor Kurzem über das Release von OpenClaw für die Brave API angemeldet haben.

API-Assistent

Außerdem haben wir einen in das Entwicklerportal integrierten API-Assistenten veröffentlicht, der dafür trainiert wurde, Fragen zur Brave Search API zu beantworten, Sie auf relevante Endpunkte verweisen kann, Codebeispiele bereitstellt und Ihnen zeigt, was Sie alles mit der Brave Search API erreichen können.

Einfachere, günstigere Tarife mit größerem Leistungsumfang

Alle vorhandenen API-Funktionen sind den folgenden öffentlich verfügbaren Tarifen zugeordnet: „Search“, „Answers“, „Spellcheck“ und „Autocomplete“. Für jeden Tarif erhalten Sie ein kostenloses Guthaben in Höhe von 5 $, das Monat für Monat erneuert wird (insgesamt 20 $ bei Nutzung aller Tarife). Dies eröffnet Ihnen eine äußerst benutzerfreundliche Möglichkeit, mit der Erstellung von Anwendungen zu beginnen. Um dieses kostenlose Guthaben zu nutzen, müssen Sie lediglich die Brave Search API auf der Website bzw. auf den Info-Seiten Ihres Projekts angeben.

Suchen

Dieser Tarif beinhaltet sämtliche Suchkategorien: Web-, LLM Context- (heute neu veröffentlicht), Bilder-, Nachrichten- und Videosuche sowie weitere Optionen. Die Preisgestaltung ist immer gleich: 5 $ pro 1.000 Anfragen, mit einem kostenlosem Guthaben von 5 $ pro Monat.

Antworten

Vor einigen Monaten haben wir einen speziellen „Answers“-Tarif eingeführt, der fundierte Antworten auf jede Frage liefert. Dieser Endpunkt erreicht beim SimpleQA-Benchmarking einen hervorragenden F1-Score von 94,1 % und wurde eigens entwickelt, um LLM-Halluzinationen zu vermeiden. Lesen Sie hier unsere Dokumentation zum Tarif „Answers“.

Der Preis für „Answers“ beträgt 4 $ pro 1.000 Websuchen zzgl. 5 $ pro Millionen Token (Input und Output). Die ersten 5 $ stehen Ihnen jeden Monat als kostenloses Guthaben zur Verfügung.

Der Tarif „Answers“ ist ideal geeignet für alle, die bei minimalem Einrichtungsaufwand von abrufbereiten Informationen profitieren möchten. Die neue LLM Context API (unter „Search“) hingegen empfiehlt sich für diejenigen, die die Kontrolle über die LLM-Ebene behalten und die von ihnen bevorzugten Modelle ausführen möchten, während sie gleichzeitig die hochwertigsten Eingabedaten für diese LLMs erhalten – und zwar auf tokeneffiziente Weise.

Spellcheck

Diese API bietet Rechtschreibprüfungen als Service. Der Preis beträgt 5 $ pro 10.000 Anfragen mit einem kostenlosen Guthaben von 5 $ pro Monat. Die Rechtschreibprüfung ist eine in Such-Endpunkte integrierte Funktion, bei der für alle Anfragen standardmäßig eine Rechtschreibprüfung durchgeführt wird.

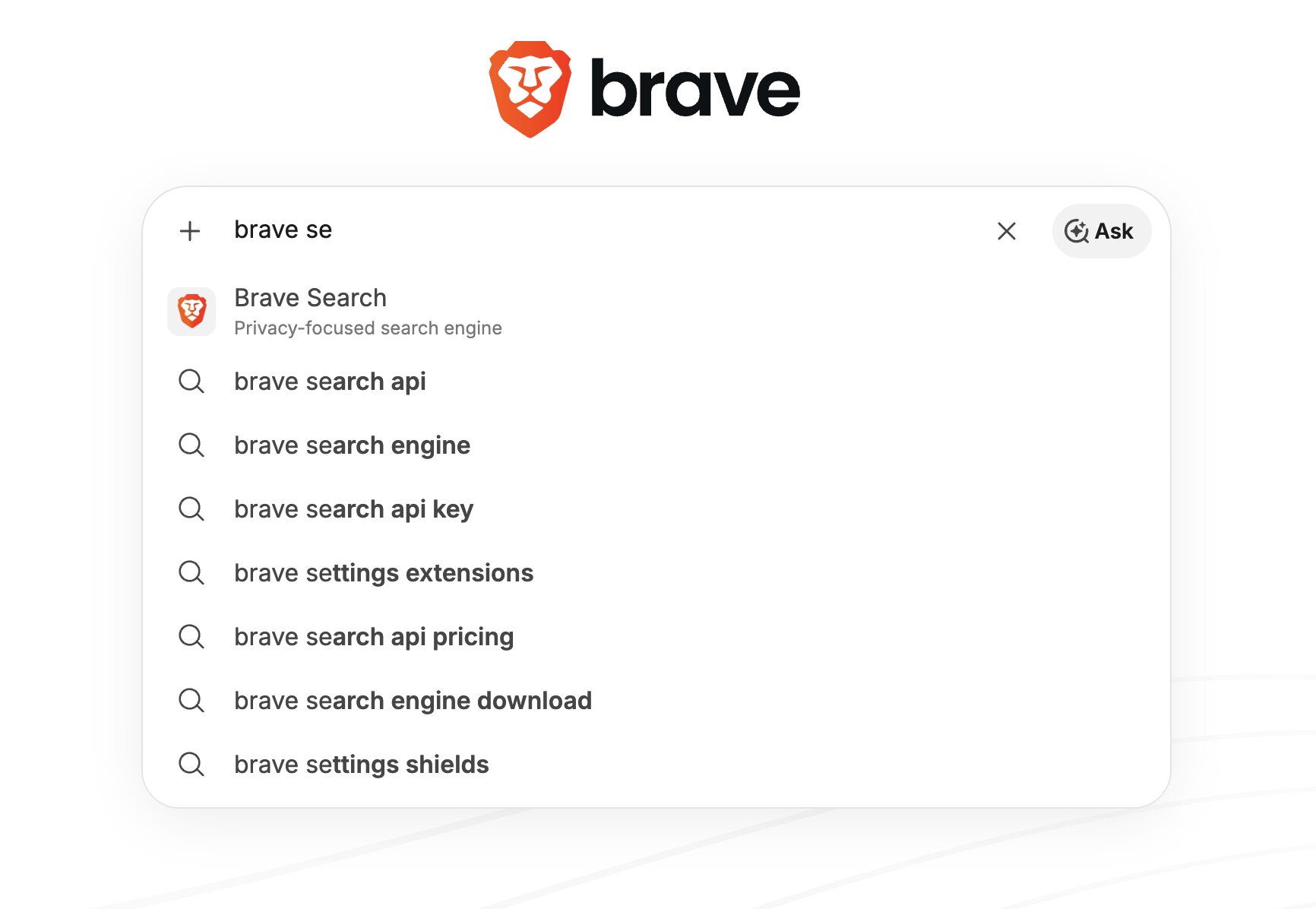

Autocomplete

Diese API bietet für jede Anfrage Vorschläge als Service. Sie beinhaltet eine Entitätserkennung und kostet 5 $ pro 10.000 Anfragen mit einem kostenlosen Guthaben von 5 $ pro Monat.

Gründe für die Verwendung der Brave Search API

Angesichts der zunehmenden Verbreitung von LLMs wird die Qualität des Kontextes, der ihnen zur Verfügung gestellt wird, zum wichtigsten Unterscheidungsmerkmal für die Anwendungsqualität.

Die Brave Search API ist optimiert für umfangreiche, kommerziell genutzte LLMs sowie für Unternehmen, die ihre Agenten oder KI-Apps durch Einbindung von Milliarden von Ergebnissen aus dem Web mit einem einfachen API-Aufruf betreiben wollen. Die Brave Search API unterstützt bereits einen Großteil der weltweit führenden KI-LLM-Unternehmen. Als unabhängige und private API ist sie die erste Wahl für umfangreiche KI-Apps, da sie sich durch die folgenden Vorteile auszeichnet:

-

Keine mit Scrapern einhergehenden Komplikationen: Brave ist neben den Big-Tech-Angeboten der einzige Web-Suchindex in dieser Größenordnung. Andere Anbieter setzen Scraper ein. Scraper verstoßen gegen Nutzungsbedingungen, können keine echte Zero Data Retention bieten, einige werden von Google verklagt, ihr Datenfeed kann willkürlich abgeschaltet werden und leiden mitunter unter Latenzproblemen. Anbieter von Unternehmenslösungen sollten es vermeiden, ihre Kunden inhärenten Haftungsrisiken von Scrapern auszusetzen.

-

Keine Interessenkonflikte: Brave verwendet Ihre Suchanfragen nicht, um die eigenen LLMs zu trainieren.

-

Zero Data Retention (ZDR): Anfragen werden nicht gespeichert, protokolliert oder mit Identitäten verknüpft, was echte ZDR ermöglicht, es erfolgt also keine Datenaufbewahrung. Da wir unsere gesamte Suchtechnologie selbst besitzen und betreiben, können wir über alle unsere Endpunkte hinweg ZDR ohne Qualitätseinbußen anbieten.

-

Geprüfte Sicherheit mit SOC 2 (Typ II)-Zertifizierung: Optimieren Sie die Legal Due Diligence und gewährleisten Sie strenge Sicherheits- und Datenschutzstandards.

-

Compliance und Kontinuität: Die unabhängige Infrastruktur von Brave verhindert die Abhängigkeit von Dritten und stellt sicher, dass Anfragen niemals bei Big-Tech-Unternehmen landen. Im Gegensatz zu Scrapern, bei denen die Gefahr besteht, dass sie bei Verstößen gegen Nutzungsbedingungen umgehend abgeschaltet werden (wie im Fall der Klage von Google gegen SerpAPI), bietet Brave eine solide und rechtlich einwandfreie Lösung.

Starten Sie noch heute mit der Brave Search API durch.